Resolução CFM 2.454/2026: Guia de adequação para HealthTechs e IA Médica

Escrito por Laura Tostes, advogada especializada em proteção de dados para empresas de tecnologia e fintechs na NDM Advogados.

Há mais de 10 anos oferecemos assessoria jurídica e contábil completa para empresas tech crescerem com segurança e poderem focar no que importa.

Atualizado em 04/03/2026

Imagine uma plataforma de saúde que, em segundos, analisa exames, cruza histórico clínico e sugere um diagnóstico. Impressionante, certo? Mas imagine também que esse mesmo algoritmo comunica o resultado diretamente ao paciente, sem filtro, sem contexto, sem um médico por trás da tela.Esse cenário, que até ontem vivia em uma zona cinzenta regulatória, acaba de encontrar seus limites.

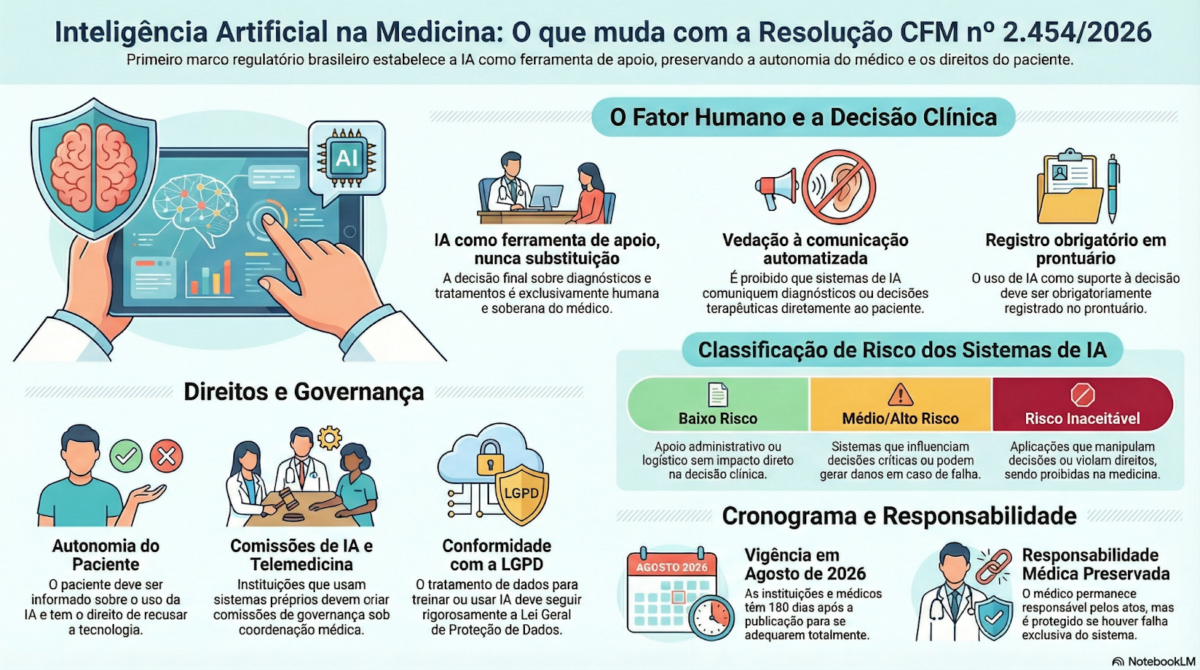

No dia 27 de fevereiro de 2026, o Conselho Federal de Medicina publicou a Resolução CFM 2.454/2026: o primeiro marco regulatório setorial dedicado exclusivamente à Inteligência Artificial no exercício da medicina no Brasil. E com ele, um recado claro para todo o ecossistema de HealthTechs: a era da IA médica sem regras acabou.

O prazo? 180 dias. O vencimento? Agosto de 2026.

O relógio já está correndo e neste artigo te contamos o que as plataformas de Health Techs precisarão fazer para se adequar.

Antes de entrar nos detalhes técnicos, vale entender a razão de existir da norma. O CFM não está proibindo a IA na medicina. Muito pelo contrário. A Resolução CFM 2.454/2026 parte de uma premissa equilibrada e bastante sofisticada:

A IA pode (e deve) ser uma aliada poderosa da medicina. Mas aliada, não soberana

Três pilares sustentam essa visão:

Nenhum sistema de IA opera de forma autônoma em decisões clínicas. O médico não é apenas um usuário da ferramenta: ele é o garantidor final de cada ato médico, independentemente de quão sofisticado seja o algoritmo.

A IA não pode ser o mensageiro de notícias que mudam vidas. Diagnósticos, prognósticos e decisões terapêuticas precisam passar obrigatoriamente pela mediação humana antes de chegar ao paciente.

A tecnologia pode errar, mas o médico continua respondendo. A Resolução CFM 2.454/2026reforça que a sofisticação da ferramenta não dilui nem elimina a responsabilidade profissional.

Aqui está um ponto que as HealthTechs precisar saber: seu cliente médico agora tem direitos legalmente garantidos sobre como pode (e como não pode) ser exigido a usar sua plataforma.

O Art. 3º estabelece 5 direitos fundamentais que vão moldar diretamente as relações comerciais e contratuais do setor:

O impacto disso para as HealthTechs é direto: cláusulas contratuais abusivas, interfaces que induzem o médico a depender cegamente da IA e falta de transparência algorítmica passam a configurar violações regulatórias.

A Resolução CFM 2.454/2026 adota uma abordagem de regulação proporcional ao risco: quanto maior o potencial de dano, maior o nível de controle exigido. Antes de lançar ou manter qualquer funcionalidade de IA, as HealthTechs precisam realizar uma Avaliação Preliminar de Risco.

Veja como funciona a lógica:

| Nível de Risco | O que define | Exemplos Práticos (Anexo II) |

| Baixo | Impacto mínimo ou inexistente nos direitos fundamentais e segurança do paciente. | Agendamento automatizado, chatbots informativos, logística de insumos |

| Médio | Impacto adverso possível, mas mitigável com supervisão humana ativa | Suporte à decisão clínica onde o erro é detectável e corrigível pelo médico. |

| Alto | Elevado potencial de dano físico ou moral; contextos de vida ou morte | IA em decisões críticas, pacientes vulneráveis ou automação com impacto clínico direto. |

| Inaceitável | Proibição Completa. Aplicações incompatíveis com a ética médica. | Sistemas de scoring social, exploração de vulnerabilidades ou manipulação da decisão médica. |

Atenção: essa classificação não é estática. Um sistema que hoje é de risco médio pode migrar para alto conforme seu grau de autonomia aumenta ou sua base de dados se expande. A reavaliação contínua é parte do processo de conformidade.

Chegamos ao coração deste artigo. Como, na prática, uma HealthTech se adequa à Resolução CFM 2.454/2026? A resposta envolve quatro frentes simultâneas que precisam andar juntas:

O CFM foi além de criar regras. Ele recomendou um framework internacional de validação para que as HealthTechs possam demonstrar, com evidências, que seus sistemas são confiáveis. Conheça o FUTURE-AI:

Adotar esse framework não é apenas conformidade, é diferenciação de mercado. Clientes institucionais, compradores de planos de saúde e reguladores vão começar a exigir esse tipo de evidência.

Um aspecto que as HealthTechs voltadas ao B2C precisam tratar com atenção especial: o Art. 5º, §3º garante ao paciente o direito de recusa informada ao uso da IA em seu atendimento.

Isso tem implicações diretas no design do produto:

Em outras palavras: a UX da saúde precisa ser redesenhada com transparência como valor central, não como nota de rodapé nos termos de uso.

A Resolução CFM 2.454/2026 não é o fim da inovação na saúde digital. É o início de uma fase mais madura, onde a confiança se torna o principal ativo de qualquer plataforma.

As HealthTechs que encaram a adequação como custo vão atrasar e sofrer sanções. As que enxergam como investimento estratégico vão sair na frente – com produtos mais robustos, contratos mais sólidos e uma reputação que o mercado está começando a exigir.

1. O que muda de fato com a nova Resolução do CFM? A resolução estabelece o primeiro marco regulatório para o uso de IA na medicina no Brasil. O ponto central é que a IA deve ser uma ferramenta de apoio, nunca substituta do médico. Ficam proibidos diagnósticos e decisões terapêuticas comunicados ao paciente de forma 100% autônoma pela máquina.

2. Qual é o prazo para as HealthTechs se adequarem? As plataformas têm 180 dias a partir da publicação (27 de fevereiro de 2026). Portanto, o prazo final para estar em total conformidade é agosto de 2026.

3. Uma IA pode enviar um diagnóstico diretamente para o paciente? Não. De acordo com o Art. 5º, §2º, a comunicação de diagnósticos, prognósticos e condutas terapêuticas exige obrigatoriamente a mediação humana. O médico deve revisar e validar a informação antes que ela chegue ao paciente.

4. Como funciona a classificação de risco das IAs? A resolução classifica as aplicações em quatro níveis:

5. O médico pode se recusar a usar uma ferramenta de IA da minha plataforma? Sim. A resolução garante ao médico a autonomia profissional. Ele tem o direito de recusar tecnologias que não considere validadas cientificamente ou que contrariem seu julgamento ético, sem sofrer retaliações ou imposição de metas por instituições.

6. O que é o Framework FUTURE-AI mencionado na norma? É um guia internacional de boas práticas que o CFM recomenda para a validação de sistemas de IA. Ele foca em seis pilares: Equidade, Universalidade, Rastreabilidade, Usabilidade, Robustez e Explicabilidade. Seguir este modelo ajuda a comprovar a segurança e a seriedade da sua HealthTech.

7. O paciente precisa autorizar o uso de IA no seu atendimento? Sim. O paciente tem o direito de recusa informada. As plataformas devem oferecer termos de consentimento claros e granulares, permitindo que o usuário entenda onde a IA está sendo aplicada e opte por não utilizá-la, se desejar.

8. Quais os requisitos técnicos imediatos para o desenvolvimento (Dev)? As HealthTechs devem focar em:

O diagnóstico de conformidade é o primeiro passo. E agosto de 2026 está mais perto do que parece.

Sua plataforma está preparada?

Estamos prontos para ajudar sua startup a crescer. Agende uma consulta e saiba mais!

Estamos prontos para ajudar seu negócio a crescer. Agende uma consulta e saiba mais!